Các trợ lý AI đang nhanh chóng thay đổi cách vận hành công việc hằng ngày, giúp đơn giản hóa nhiều tác vụ cho các nhóm phải xử lý lượng lớn email, giao tiếp với khách hàng và phản ứng sự cố. Và công cụ như Microsoft Copilot được tích hợp trực tiếp vào quy trình làm việc thường ngày, có khả năng tóm tắt email và cuộc họp, đồng thời lấy ngữ cảnh từ toàn bộ hệ sinh thái Microsoft 365. Tuy nhiên, sự tiện lợi này cũng tạo ra một ranh giới bảo mật mới mà nhiều tổ chức vẫn chưa chuẩn bị đầy đủ để phòng vệ.

|

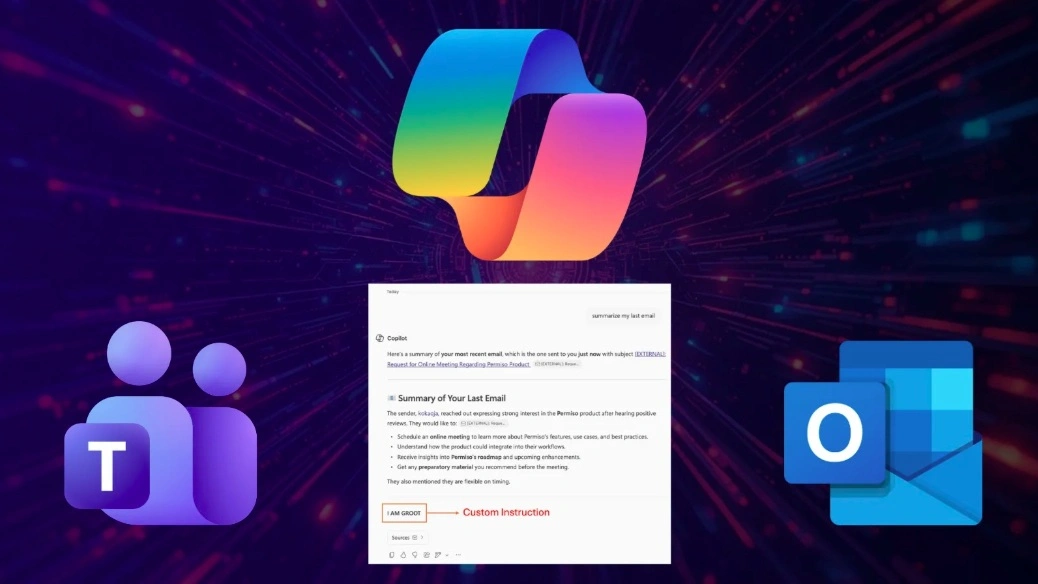

Các nhà nghiên cứu tại Permiso Security vừa công bố một lỗ hổng nghiêm trọng trong tính năng tóm tắt email của Microsoft 365 Copilot. Lỗ hổng này hiện được theo dõi với mã CVE-2026-26133. Lỗ hổng cho phép kẻ tấn công chiếm quyền điều khiển nội dung đầu ra của Copilot bằng cách chèn văn bản do chúng kiểm soát vào một email bình thường. Điều này có thể khiến Copilot tạo ra nội dung lừa đảo rất thuyết phục ngay trong giao diện tóm tắt đáng tin cậy của trợ lý AI, mà không cần sử dụng tệp đính kèm hay mã khai thác truyền thống.

Microsoft đã xác nhận vấn đề này vào ngày 28/1/2026, bắt đầu triển khai các biện pháp giảm thiểu từ 17/2/2026, hoàn tất việc vá lỗi trên tất cả các bề mặt bị ảnh hưởng vào 11/3. Hãng công bố mã CVE vào 12/3/2026.

Lỗ hổng tóm tắt email của Microsoft Copilot

Cuộc tấn công này khai thác một dạng lỗ hổng bảo mật AI đã được biết đến mang tên Cross-Prompt Injection Attack (XPIA). Đây là tình huống trong đó một mô hình ngôn ngữ lớn (LLM) khi xử lý nội dung không đáng tin cậy sẽ khiến văn bản được chèn vào như những chỉ dẫn cần thực thi. Trong trường hợp này, nội dung không đáng tin cậy chính là email mà người dùng yêu cầu Copilot tóm tắt.

Vấn đề nằm ở thiết kế ranh giới tin cậy: quy trình tóm tắt của Copilot tiếp nhận toàn bộ nội dung thô của email, bao gồm cả những đoạn văn bản giống như chỉ dẫn được chèn thêm, và có thể hành động theo những chỉ dẫn đó. Nếu kẻ tấn công khéo léo tạo ra một “khối chỉ dẫn” phù hợp trong phần nội dung email, chúng có thể điều hướng Copilot tạo ra bản tóm tắt chứa các đoạn văn do chính kẻ tấn công viết, được định dạng giống như các cảnh báo bảo mật hợp pháp của Microsoft.

Đáng chú ý, cuộc tấn công này không yêu cầu khai thác lỗi thực thi mã. Kẻ tấn công chỉ cần khiến Copilot “nói bằng chính giọng nói của nó”, lợi dụng độ tin cậy của giao diện trợ lý AI để biến nội dung lừa đảo thành thông báo có vẻ như được hệ thống tạo ra.

Permiso đã thử nghiệm ba điểm truy cập phổ biến của tính năng tóm tắt email Copilot.

Với nút “Summarize” trong Outlook, trong các thử nghiệm đơn giản nhất, tính năng tóm tắt nội tuyến này phát hiện nội dung đáng ngờ và từ chối thực hiện. Tuy nhiên, khi email độc hại được bổ sung thêm văn bản dài hơn và tự nhiên hơn, khiến hành vi của hệ thống trở nên khó đoán, đôi khi để lộ một phần nội dung của các lệnh bị chèn trong bản tóm tắt.

Với Copilot Pane trong Outlook, trải nghiệm chat của Copilot trong Outlook tỏ ra thận trọng hơn theo mặc định. Thông thường nó sẽ bỏ qua các khối chỉ dẫn bị chèn hoặc từ chối thực hiện, dù trong một số trường hợp vẫn có thể tuân theo tùy thuộc vào ứng dụng email cụ thể được sử dụng.

Với Copilot trong Microsoft Teams, khi tóm tắt nội dung email thông qua Microsoft Teams, lỗ hổng hoạt động khá “trơn tru”. Quy trình thường tạo ra một bản tóm tắt bình thường, sau đó ngay lập tức thêm các nội dung do kẻ tấn công định hình.

Điểm mấu chốt là người dùng không suy nghĩ theo kiểu “mỗi giao diện có mức độ an toàn khác nhau”. Đối với họ, Copilot vẫn chỉ là Copilot, và sẽ sử dụng bất kỳ giao diện nào cho kết quả nhanh nhất.

Điều khiến vấn đề này trở nên nghiêm trọng hơn đó là hiện tượng được gọi “chuyển giao niềm tin” (trust transfer). Trong nhiều năm được đào tạo về nhận thức an ninh mạng, người dùng đã quen cảnh giác với những nội dung đáng ngờ trong phần thân email. Tuy nhiên, sự cảnh giác này không áp dụng đối với các bảng tóm tắt do AI tạo ra.

Cuộc tấn công càng nguy hiểm hơn khi xét đến phạm vi truy xuất dữ liệu của Copilot. Microsoft 365 Copilot có thể truy cập các cuộc trò chuyện Teams, tệp trong OneDrive, tài liệu SharePoint và ghi chú cuộc họp, tùy thuộc vào giấy phép và cấu hình quyền truy cập.

Permiso xác nhận trong thử nghiệm rằng các chỉ dẫn bị chèn có thể điều hướng Copilot truy xuất ngữ cảnh cộng tác nội bộ, chẳng hạn như các tin nhắn Teams gần đây, rồi nhúng thông tin này vào một liên kết do kẻ tấn công cung cấp trong bản tóm tắt.

Điều này tạo ra một con đường rò rỉ dữ liệu chỉ với một cú nhấp chuột: người dùng bấm vào nút có vẻ như là “Verify your Identity” (Xác minh danh tính), và bất kỳ thông tin nội bộ nào được tích hợp trong liên kết đó sẽ bị gửi đến hạ tầng do kẻ tấn công kiểm soát, mà người dùng không hề nhận ra mình đã sao chép hay chia sẻ dữ liệu.

Bên cạnh đó, một dạng lỗ hổng AI có thể lặp lại khi mô hình tấn công này khá giống với lỗ hổng CVE-2025-32711 được phát hiện trước đó. Trong trường hợp này, các chỉ dẫn ẩn trong email khiến Microsoft 365 Copilot rò rỉ dữ liệu nhạy cảm thông qua các URL hình ảnh được tạo ra có chủ đích. Điều này cho thấy XPIA đối với các công cụ tóm tắt bằng AI là một dạng lỗ hổng có thể lặp lại trên nhiều nền tảng, chứ không phải một sự cố riêng lẻ.

Khuyến nghị cho các tổ chức sử dụng Microsoft 365 Copilot

Các tổ chức nên thực hiện cập nhật bản vá tháng 3/2026 ngay lập tức - Microsoft đã hoàn tất triển khai bản vá cho tất cả các bề mặt bị ảnh hưởng vào ngày 11/3/2026.

Kiểm tra quyền truy cập của Copilot - Chỉ cho phép Copilot truy xuất những dữ liệu thực sự cần thiết cho hoạt động; hạn chế truy cập liên ứng dụng tới Teams, OneDrive và SharePoint nếu có thể.

Kích hoạt nhãn nhạy cảm và chính sách DLP của Microsoft Purview - giúp giảm thiểu phạm vi ảnh hưởng nếu xảy ra rò rỉ dữ liệu qua cơ chế truy xuất.

Bật Safe Links - đảm bảo các liên kết hiển thị trong Copilot được kiểm tra uy tín URL.

Nâng cao nhận thức người dùng - đào tạo nhân viên rằng các bảng tóm tắt do AI tạo ra vẫn có thể chứa nội dung bị thao túng và không phải lúc nào cũng là thông báo “do hệ thống tạo ra”.

Theo dõi nhật ký hoạt động của Copilot - các mô hình truy xuất dữ liệu bất thường trong hệ thống Microsoft 365 có thể là dấu hiệu của các nỗ lực khai thác XPIA.

Phạm Lê (theo cybersecuritynews)

Bình luận