Từ công cụ tiến bộ đến vũ khí nguy hiểm

AI vốn được thiết kế nhằm phục vụ lợi ích cho con người, hướng đến tăng năng suất lao động, hỗ trợ nghiên cứu khoa học, giảm thiểu rủi ro. Hiệu quả của các ứng dụng AI trong đời sống là không cần phải bàn cãi. Nhưng cũng như bất cứ một công cụ nào khác, AI cũng là con dao hai lưỡi, khi rơi vào tay những kẻ có ý đồ xấu, công nghệ này dễ dàng biến thành “vũ khí số” cực kỳ nguy hiểm.

Thuật ngữ “AI bóng tối” (Shadow AI) được các chuyên gia an ninh mạng dùng để chỉ những hệ thống trí tuệ nhân tạo phát triển ngoài sự giám sát pháp lý hoặc bị sử dụng cho mục đích bất hợp pháp. Khác với “AI hợp pháp”, vốn được quản lý minh bạch và hướng tới phục vụ lợi ích cộng đồng, “AI bóng tối” lại vận hành trong các không gian ngầm trên mạng, nơi hacker và tội phạm trao đổi công cụ tấn công, bán dữ liệu, hoặc thậm chí thuê AI như một dịch vụ.

|

| AI bóng tối đang ngày càng phổ biến trong giới tội phạm |

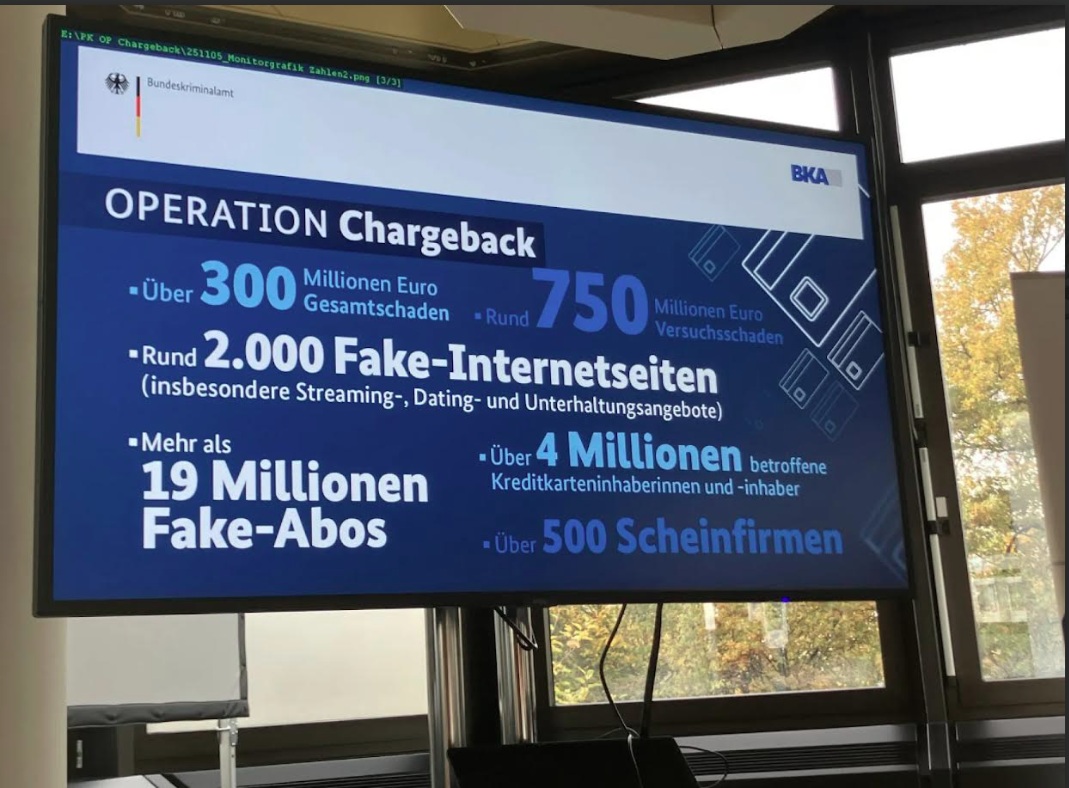

Theo báo cáo của Europol năm 2024, hơn 65% các vụ lừa đảo trực tuyến quy mô lớn ở châu Âu đã có sự tham gia của công nghệ AI. Đặc biệt, các chatbot giả mạo nhân viên ngân hàng hoặc nhân viên hỗ trợ kỹ thuật đang trở nên phổ biến một cách đáng lo ngại. Interpol cũng cảnh báo rằng AI đang giúp các băng nhóm tội phạm “tự động hóa” nhiều khâu trong chuỗi tấn công mạng, từ viết mã độc, dò quét lỗ hổng cho đến triển khai phần mềm tống tiền (ransomware).

Điều khiến AI trở nên nguy hiểm là khả năng tự học và thích ứng. Một khi được “huấn luyện” để phục vụ hành vi xấu, AI không chỉ sao chép các mẫu tấn công truyền thống mà còn tạo ra biến thể mới, với sự linh hoạt đáng sợ liên tục vượt qua hệ thống phòng thủ. Thêm vào đó, tính “tự động hoá” khiến AI trở thành kẻ tấn công không biết mệt mỏi. Các chuyên gia tại Viện Công nghệ Massachusetts (MIT) đã từng nhấn mạnh rằng: “Khác với hacker con người vốn bị giới hạn bởi thời gian và kỹ năng, một AI bóng tối có thể tấn công không ngừng nghỉ và nhân rộng trên quy mô toàn cầu chỉ trong vài giờ”.

Bức tranh toàn cầu: AI trong tay tội phạm mạng và hệ quả xã hội

|

| Phát triển AI không kiểm soát chính là một nguy cơ đối với thế giới. |

Khi quan sát thực tế, chúng ta thấy rõ AI bóng tối đã và đang được triển khai ở nhiều cấp độ. Từ những deepfake chính trị cho đến ransomware tinh vi, các ví dụ ngày càng dày đặc cho thấy ranh giới giữa công nghệ phục vụ nhân loại và công nghệ chống lại nhân loại đang trở nên mong manh.

Một trong những hiện tượng nguy hiểm nhất là deepfake (tin giả). Theo thống kê của công ty Sensity AI đến từ Hà Lan, số video deepfake lưu hành trên mạng đã tăng gấp 9 lần trong giai đoạn 2022–2024. Từ hình ảnh lãnh đạo chính trị bị giả mạo để đưa ra phát ngôn sai lệch đến video tống tiền cá nhân, deepfake đang trở thành “vũ khí thông tin giả” gây ảnh hưởng nghiêm trọng đến uy tín, danh dự và cả an ninh quốc gia. Tổng thư ký Liên Hợp Quốc António Guterres từng cảnh báo tại một hội nghị năm 2024 rằng: “Deepfake và các hình thức giả mạo bằng AI có thể làm lung lay nền móng niềm tin xã hội, và khi niềm tin biến mất, sự ổn định chính trị cũng sụp đổ”.

AI cũng đã thay đổi bản chất các cuộc tấn công mạng. IBM Security trong báo cáo năm 2025 cho biết: trước đây thời gian trung bình để hacker phát triển một biến thể ransomware mới thường mất hàng tuần, thì nay với sự hỗ trợ của AI, thời gian này rút ngắn xuống chỉ còn vài giờ. Điều này khiến hệ thống phòng thủ mạng, vốn đã chật vật với các mối đe dọa truyền thống càng bị đẩy vào thế bị động.

Hacker hiện nay không còn cần kỹ năng lập trình quá cao, bởi trên các diễn đàn darknet, những dịch vụ “AI-as-a-Service” (dịch vụ AI) đang nở rộ. Tin tặc chỉ cần trả phí là có thể thuê các mô hình AI chuyên dụng để phát hiện lỗ hổng, viết mã độc hay tạo ra email lừa đảo với độ chính xác gần như hoàn hảo. Tập đoàn công nghệ Microsoft từng cảnh báo rằng: “Chúng ta đang chứng kiến sự dân chủ hóa quyền lực tấn công mạng. Thay vì cần một nhóm hacker tinh vi, giờ chỉ cần một cá nhân với ngân sách vừa phải cũng có thể phát động cuộc tấn công toàn cầu nhờ AI”. Điều này dẫn đến những hệ quả kinh tế xã hội khôn lường.

Công ty kiểm toán McKinsey cũng dự báo nếu AI tiếp tục bị lạm dụng mà không có biện pháp kiểm soát, thiệt hại kinh tế toàn cầu có thể lên tới 8 nghìn tỷ USD vào năm 2030. Với cá nhân, rủi ro không chỉ là mất tiền trong các vụ lừa đảo, mà còn bị đe dọa quyền riêng tư khi dữ liệu cá nhân bị khai thác để tạo ra các kịch bản tống tiền. Với doanh nghiệp, các vụ tấn công AI có thể làm mất uy tín doanh nghiệp, làm tê liệt chuỗi cung ứng thậm chí gây gián đoạn toàn cầu. Với quốc gia, nguy cơ lớn nhất là sự bất ổn chính trị khi AI được sử dụng để thao túng bầu cử, lan truyền tin giả hoặc kích động xung đột xã hội. Không phải ngẫu nhiên mà Giám đốc Cục Điều tra Liên bang Mỹ (FBI), ông Christopher Wray từng khẳng định: “Mối đe dọa từ việc AI rơi vào tay kẻ xấu không thua kém vũ khí sinh học hay hạt nhân. Điểm khác biệt là AI dễ tiếp cận hơn nhiều, và điều đó khiến nó trở nên nguy hiểm gấp bội”.

Cuộc chiến giữa ánh sáng và bóng tối

|

| Tội phạm có thể tận dụng sức mạnh của AI để gia tăng sức tấn công. |

Trước sự trỗi dậy của AI bóng tối, câu hỏi lớn nhất đặt ra là: ai sẽ chịu trách nhiệm kiểm soát? Hiện nay, các quốc gia lớn đều đã có bước đi riêng. Mỹ đã thành lập AI Safety Institute từ năm 2023 với mục tiêu đặt ra các tiêu chuẩn an toàn cho AI. Năm 2024, Liên minh châu Âu cũng đã thông qua AI Act, bộ luật toàn diện đầu tiên trên thế giới nhằm phân loại rủi ro của các ứng dụng AI. Nhật Bản, Hàn Quốc, Singapore cũng triển khai chiến lược quốc gia về quản trị AI riêng tập trung vào việc cân bằng giữa đổi mới và kiểm soát. Tuy nhiên, các nỗ lực này mới dừng lại ở cấp độ khu vực, chưa có một công ước toàn cầu như trong lĩnh vực chống vũ khí hạt nhân hay biến đổi khí hậu. OECD và UNESCO nhiều lần kêu gọi xây dựng một khung quản trị AI mang tính toàn cầu, nhấn mạnh đến tính minh bạch và trách nhiệm.

Bên cạnh các chính phủ, trách nhiệm cũng đặt nặng lên vai các tập đoàn công nghệ. Các CEO như Elon Musk, Sam Altman (OpenAI), Sundar Pichai (Google) đều thừa nhận rằng AI có nguy cơ vượt khỏi tầm kiểm soát. Ông Musk từng ví von: “AI không được quản lý giống như việc chế tạo bom nguyên tử trong gara. Không ai muốn sống trong một thế giới như vậy”. Giám đốc của Google, ông Sundar Pichai gần đây cho biết công ty đang chủ động xây dựng “hàng rào an toàn” cho AI, nhưng ông cũng thừa nhận “không một công ty đơn lẻ nào có thể giải quyết vấn đề này”.

Giải pháp khả dĩ nhất hiện nay là tăng cường hợp tác quốc tế và thiết lập tiêu chuẩn chung. Diễn đàn kinh tế Thế giới đã đưa ra khuyến nghị các quốc gia cần chia sẻ dữ liệu về tấn công AI, đồng thời buộc các công ty phát triển AI phải chịu trách nhiệm pháp lý khi sản phẩm bị lạm dụng. NATO thì nhấn mạnh rằng AI không chỉ là vấn đề công nghệ, mà còn là thách thức an ninh quốc phòng toàn diện. Trong hội nghị G7 mở rộng năm 2024, cựu Thủ tướng Nhật Bản Kishida Fumio đã từng nhấn mạnh: “Chúng ta không thể để AI trở thành công cụ của tội phạm xuyên quốc gia. Một công ước quốc tế về AI cần được xem như ưu tiên cấp bách”. Những nỗ lực của cộng đồng quốc tế đã dẫn tới Công ước quốc tế đầu tiên về tội phạm mạng được dự kiến mở ký vào cuối tháng 10/2025 này tại Hà Nội. Đây được coi là nỗ lực tập thể lớn nhất của Liên hợp quốc từ trước tới nay trong cuộc chiến chống lại tội phạm thời đại mới. Nhưng cuộc chiến giữa ánh sáng và bóng tối trong kỷ nguyên AI mới chỉ bắt đầu. Nếu được quản trị tốt, AI có thể trở thành động lực phát triển vĩ đại nhất của thế kỷ XXI. Nhưng nếu bị bỏ mặc, AI bóng tối sẽ trở thành “cơn ác mộng công nghệ”, đưa nhân loại bước vào kỷ nguyên bất ổn chưa từng có.

Tiểu Phong

Bình luận