Chỉ sau quãng thời gian ngắn, các mô hình ngôn ngữ lớn (LLM) và AI tạo sinh (GenAI) đã cho thấy khả năng vượt trội trong việc viết văn bản, lập trình, phân tích dữ liệu, tạo hình ảnh, âm thanh và video với chất lượng ngày càng tiệm cận con người. Giờ đây, AI được tích hợp nhanh chóng vào các nền tảng email, công cụ tìm kiếm, mạng xã hội, hệ thống chăm sóc khách hàng, tài chính ngân hàng, y tế và cả các hạ tầng quan trọng. Tuy nhiên, AI đang mang lại cả cơ hội và rủi ro.

Tội phạm thời AI tinh vi hơn, nguy hiểm hơn

Đầu năm 2024, giới tài chính công nghệ toàn cầu từng choáng váng khi cảnh sát Hong Kong điều tra vụ công ty đa quốc gia ARUP bị lừa 25 triệu USD trong một giao dịch duy nhất do deepfake. Kẻ lừa đảo giả mạo “giám đốc tài chính” ARUP, liên lạc với nhân viên thủ quỹ từ trụ sở chính ở Anh để yêu cầu anh này tham gia một cuộc gọi video bàn bạc công việc. Khi nhân viên vào phòng họp trực tuyến, anh nhìn thấy các gương mặt đều là lãnh đạo công ty, bao gồm “giám đốc tài chính”.

Bởi vậy, khi được “giám đốc” lệnh chuyển tiền, người này lập tức làm theo. Hơn một năm trôi qua, khoản tiền khổng lồ nêu trên vẫn bặt vô âm tín. Mới đây, tháng 4/2025, cảnh sát Tây Ban Nha thông báo bắt giữ 6 người đứng sau một chiến dịch lừa đảo quy mô lớn sử dụng công nghệ deepfake để dụ nạn nhân đầu tư vào tiền ảo. Qua điều tra, hàng trăm nạn nhân trên toàn thế giới đã “sập bẫy” chiêu trò này, với tổng thiệt hại ước tính 21 triệu USD.

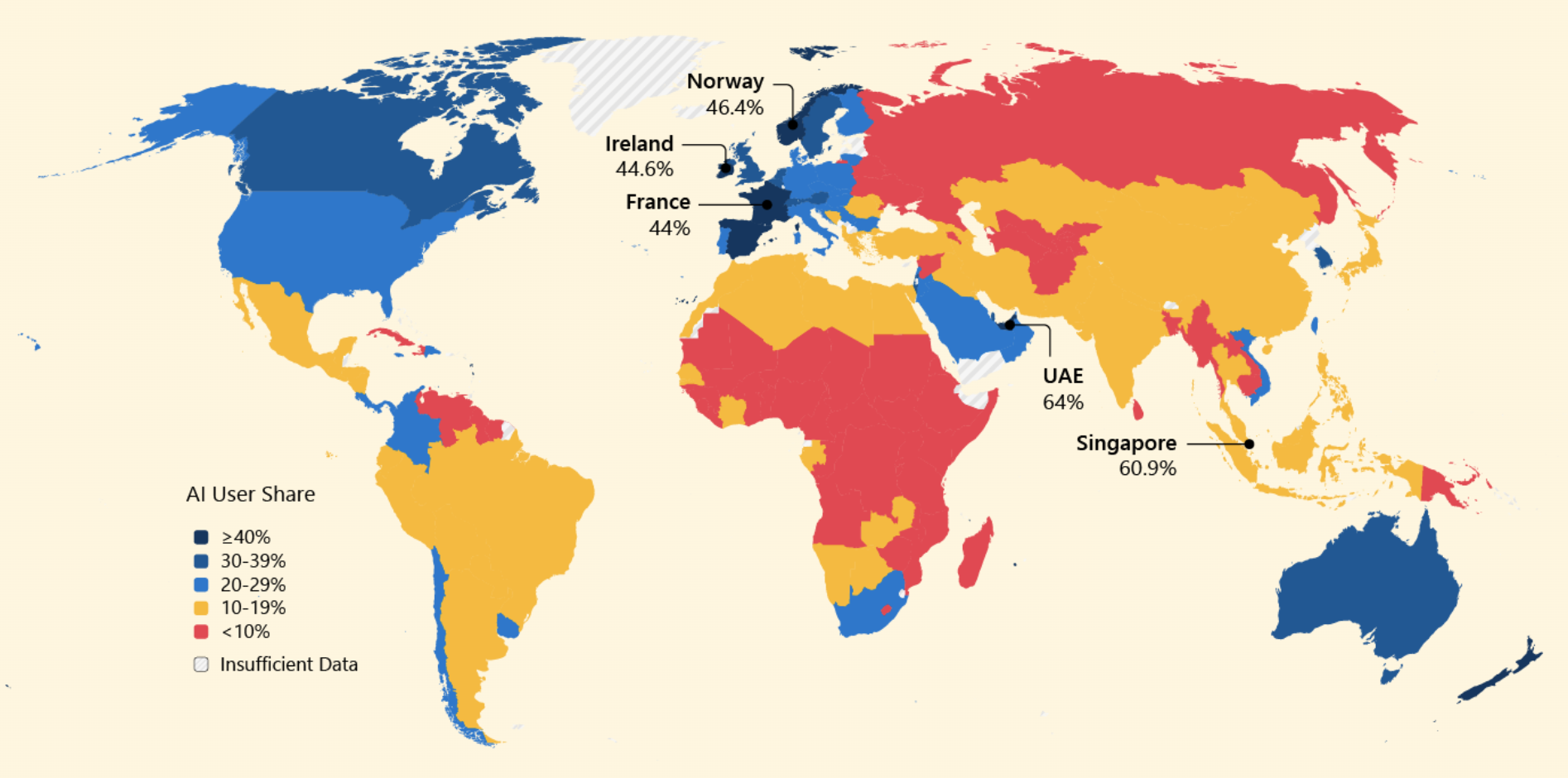

|

| Biểu đồ ứng dụng AI của các quốc gia trên thế giới năm 2025 (Nguồn: Microsoft). |

Nhưng đây chỉ là vài vụ việc bị cảnh sát các nước phát giác. Số liệu của deepstrike.io chỉ ra rằng, số lượng tệp tin dạng deepfake bị phát hiện đã tăng từ 500.000 (năm 2023) lên khoảng 8 triệu trong năm 2025. Không chỉ người dùng thông thường, deepfake còn được tội phạm sử dụng để nhắm mục tiêu tới nhân sự các công ty công nghệ hàng đầu.

Theo Công ty bảo mật Eftsure có trụ sở ở Australia, năm 2024, nhân viên công ty an ninh mạng LastPass suýt bị lừa hàng triệu USD khi nhận cuộc gọi, tin nhắn và thư thoại từ một người mạo danh CEO trên ứng dụng nhắn tin WhatsApp. Khi kiểm tra lại, các chuyên gia an ninh mạng phát hiện kẻ tội phạm sử dụng hình ảnh của CEO thật được đăng tải trên Youtube để huấn luyện AI.

Công ty bảo mật đám mây Wiz cũng từng đối mặt với một cuộc tấn công deepfake vào cuối năm 2024. Tội phạm lợi dụng AI sao chép giọng nói của CEO Assaf Rappaport và sau đó gửi tin nhắn thoại tới hàng chục nhân viên yêu cầu họ cung cấp thông tin đăng nhập.

Mức độ tự động hóa trong tội phạm mạng đang tăng nhanh. Theo công ty trí tuệ nhân tạo Anthropic, hoạt động này sử dụng hệ thống AI để điều hướng các chiến dịch tấn công mạng và tham gia vào nhiều khâu khác nhau của một cuộc tấn công.

Trong một số vụ hack, AI thay con người “thực hiện 80-90%” lượng công việc. Báo cáo của Anthropic cũng cho biết, các nhóm tội phạm quy mô lớn, công ty tin tặc hoặc các thiết chế khác đang khai thác tiềm năng của AI, sử dụng công nghệ này để tự động hóa và tinh vi hóa các cuộc tấn công mạng, phát tán thông tin sai lệch mang tính kích động, cũng như xâm nhập các hệ thống nhạy cảm. Chẳng hạn, AI có thể biến những email lừa đảo viết vụng về thành tiếng Anh trôi chảy, hoặc tạo ra các bản sao kỹ thuật số, giả mạo thành viên cấp cao trong chính phủ để thực hiện hành vi lừa đảo.

Cũng có dấu hiệu AI bắt đầu được sử dụng trong các cuộc tấn công mạng nhắm vào một quốc gia đối thủ. Tháng 9/2025, Microsoft cảnh báo rằng, các đối thủ nước ngoài của Mỹ đang tận dụng AI để nâng cao hiệu quả các chiến dịch tấn công mạng, đồng thời giảm đáng kể công sức và chi phí triển khai các chiến dịch tấn công đó. Chủ tịch Ủy ban An toàn và An ninh của OpenAI, cơ quan có thẩm quyền giám sát và ngăn chặn những hướng phát triển AI rủi ro của nhà sản xuất ChatGPT, xác nhận các hệ thống AI mới giúp tin tặc “đạt những năng lực vượt trội hơn rất nhiều”.

|

| Báo cáo chỉ ra AI có thể thực hiện 80-90% khối lượng công việc của một cuộc tấn công mạng. |

Ở quy mô nhỏ, sự phát triển của AI giúp các nhóm hacker nhỏ và hacker đơn độc khắc phục rào cản kỹ thuật (AI có thể giúp những kẻ “tay mơ” lập trình, soát lỗi lập trình hoặc tìm kiếm điểm yếu trong hệ thống mục tiêu), theo Adam Arellano, Giám đốc công nghệ hiện trường tại Harness, một công ty công nghệ sử dụng AI để giúp khách hàng tự động hóa quá trình phát triển phần mềm.

“Tốc độ và khả năng tự động hóa mà trí tuệ nhân tạo mang lại là điều hơi đáng sợ. Thay vì một người có kỹ năng thành thạo cố gắng xâm nhập vào các hệ thống được bảo mật cao, AI đang đẩy nhanh các quy trình đó và vượt qua các trở ngại một cách nhất quán hơn”, Arellano nói. Các chuyên gia cũng phát hiện các tên tội phạm can thiệp vào các hệ thống AI sẵn có để tạo ra mô hình AI chuyên sản xuất nội dung lừa đảo, giả mạo. Công ty an ninh mạng McAfee chỉ ra hai mô hình AI “khét tiếng” là WormGPT và FraudGPT.

AI trong vai trò tuyến phòng thủ mới của an ninh mạng

Trong khi AI bị kẻ xấu lợi dụng, đặc điểm nhanh, liên tục và chính xác của AI cũng mang đến một công cụ mạnh mẽ để chuyên gia an ninh mạng có thể sử dụng để chống lại những mối đe dọa an ninh mạng.

Trước hết, AI có thể phát hiện và ngăn chặn phần mềm độc hại bằng cách liên tục phân tích các mẫu dữ liệu và hành vi bất thường, qua đó nhận diện sớm những mối đe dọa mới mà các giải pháp truyền thống dễ bỏ sót. Theo chuyên gia của McAfee và Eftsure, nhờ AI, các công cụ phân tích hành vi, học máy (ML) và học sâu (DL) có thể sàng lọc lượng lớn dữ liệu, nhận diện mẫu tấn công bất thường và phản ứng ngay lập tức.

AI giúp giám sát liên tục, phân tích dấu hiệu nguy hiểm trong thời gian thực và đưa ra cảnh báo trước khi thiệt hại lớn xảy ra. Điều này làm giảm đáng kể thời gian phản ứng đối với sự cố, đồng thời hỗ trợ trong việc truy vết nguồn gốc tấn công và phục hồi hệ thống.

|

| Bức ảnh được tạo bởi một công cụ AI khi được yêu cầu “mô tả tác động hai mặt của AI với vấn đề an ninh mạng”. |

Theo khảo sát an ninh mạng năm 2024 của KPMG, 66% các nhà lãnh đạo an ninh coi tự động hóa dựa trên AI là rất quan trọng để luôn đi trước các mối đe dọa mới và tăng cường sự linh hoạt cũng như khả năng phản ứng của các trung tâm điều hành an ninh của họ.

Từ việc xác định các lỗ hổng đến ngăn chặn các cuộc tấn công mạng trong thời gian thực, AI có tiềm năng cách mạng hóa cách chúng ta bảo vệ các hệ thống trực tuyến. Reuters mới đây cho biết, nhiều công ty công nghệ lớn hay các nhà sản xuất dịch vụ diệt virus máy tính như McAfee đều đã ứng dụng AI để phát triển các sản phẩm mới, giúp vô hiệu hóa nhiều mối đe dọa.

Lợi ích tiếp theo của AI là nó không chỉ phản ứng với các mối đe dọa đã biết mà còn có thể dự đoán các chiến lược tấn công mới dựa trên dữ liệu quá khứ và hiện tại. Điều này giúp đội ngũ an ninh mạng chủ động xây dựng biện pháp phòng ngừa, từ đó giảm đáng kể thời gian phản ứng và thiệt hại.

AI vượt trội rõ ràng so với con người trong việc sàng lọc lượng dữ liệu khổng lồ; có khả năng đọc, lọc và giám sát email; tự động phát hiện, cách ly các thư điện tử đáng ngờ, giúp giảm đáng kể nguy cơ lừa đảo. Các thuật toán AI liên tục giám sát nhật ký hệ thống và hành vi người dùng để phát hiện những sai lệch so với các chuẩn mực đã thiết lập. Chúng còn có thể xác định chính xác các hoạt động bất thường như các nỗ lực truy cập trái phép hoặc đánh cắp dữ liệu trong thời gian thực. Việc cảnh báo tức thì này cho phép các nhóm bảo mật điều tra và giảm thiểu các vi phạm tiềm tàng trước khi chúng leo thang.

Không dừng lại ở đó, AI cho phép phân tích tức thời các mối đe dọa bằng cách nhanh chóng phát hiện các mô hình và sai lệch trong lưu lượng mạng. Nhờ vậy, các tổ chức có thể hành động ngay lập tức nhằm hạn chế tác động của những cuộc tấn công có thể xảy ra.

Khi sự cố an ninh phát sinh, AI có khả năng tự động hóa quy trình ứng phó. Bằng cách tự động hóa những tác vụ lặp đi lặp lại như giám sát nhật ký hay phân tích lưu lượng mạng, AI giúp giải phóng nguồn lực con người để tập trung vào các vấn đề an ninh phức tạp hơn, đòi hỏi con người trực tiếp giám sát, ra quyết định.

Theo các chuyên gia, một ưu điểm nổi bật khác là khả năng điều chỉnh (mở rộng, thu hẹp) hoạt động của hệ thống an ninh mạng gần như tức thời theo nhu cầu. Các giải pháp dựa trên AI có thể đáp ứng khối lượng công việc ngày càng tăng mà không đòi hỏi đầu tư lớn vào phần cứng hay nhân sự.

Khi yêu cầu bảo mật của tổ chức gia tăng, hệ thống AI có thể dễ dàng thích ứng và phát triển tương ứng, mang lại giải pháp hiệu quả về chi phí cho mọi quy mô doanh nghiệp. Khả năng tích hợp linh hoạt với hạ tầng bảo mật sẵn có cũng giúp giảm thiểu gián đoạn và tối ưu hóa nguồn nhân lực, vật lực. Cuối cùng, AI đóng vai trò quan trọng trong bảo mật đám mây và thiết bị đầu cuối, giúp bảo vệ dữ liệu và hệ thống trước môi trường mối đe dọa ngày càng phức tạp.

Nhờ những ưu điểm đó, AI ngày càng được ứng dụng rộng rãi hơn trong lĩnh vực an ninh mạng. Khảo sát của hãng nghiên cứu thị trường IDC và công ty an ninh mạng Fortinet (Mỹ) được thực hiện với 550 lãnh đạo phụ trách công nghệ và an ninh mạng tại 11 thị trường châu Á - Thái Bình Dương, trong đó có Việt Nam, trong năm 2025 cho thấy, gần 90% doanh nghiệp lớn tại khu vực đã chủ động ứng dụng AI để bảo vệ hệ thống.

Hầu hết ứng dụng AI trong môi trường an ninh để tự động hóa ứng phó, dự đoán mối đe dọa, chủ động ứng phó sự cố và phân tích hành vi. AI tạo sinh cũng dần được chấp nhận tại môi trường doanh nghiệp, chủ yếu là tác vụ nhẹ như vận hành kịch bản, cập nhật quy tắc và chính sách, phát hiện tấn công lừa đảo xã hội, viết quy tắc phát hiện và hỗ trợ điều tra…

Bài toán quản trị trong kỷ nguyên số

Từ những thuận lợi và thách thức đặt ra với an ninh mạng từ AI, nhiều chuyên gia đã liên tục nêu tính cấp thiết của việc xây dựng khuôn khổ đạo đức, pháp lý để quản lý và quản trị AI nhằm hạn chế tối đa những tác động tiêu cực, bảo vệ an toàn thông tin, giúp AI thực sự phát huy giá trị vì con người, vì sự phát triển an toàn.

Ngay cả khi AI mang lại tiềm năng lớn trong việc tăng cường bảo vệ tài sản số, công nghệ này chỉ thực sự phát huy giá trị khi được triển khai có trách nhiệm, với cam kết mạnh mẽ trong bảo vệ quyền riêng tư, ngăn ngừa lạm dụng và hạn chế thiên lệch. Tổ chức Giáo dục, Khoa học và Văn hóa Liên hợp quốc (UNESCO) tin rằng, các chính phủ cần giải quyết không chỉ câu hỏi công nghệ có thể làm gì, mà cần tìm ra “AI nên làm gì?” và “Chúng ta nên sử dụng AI như thế nào để mang lại lợi ích cho con người, chứ không gây tổn hại?”.

Bài toán đặt ra với các nhà hoạch định chính sách an ninh mạng là cần chủ động đề ra những nguyên tắc cho việc triển khai AI một cách có trách nhiệm, bảo đảm các hệ thống được thiết kế và vận hành trên cơ sở tôn trọng quyền riêng tư, đề cao tính công bằng và minh bạch. Trong đó, yêu cầu then chốt là thiết lập các tiêu chuẩn rõ ràng về thu thập, lưu trữ và khai thác dữ liệu.

|

| Deepfake có thể biến một người thành người khác. Ảnh: TR. |

Các tổ chức phải công khai dữ liệu nào được thu thập, mục đích thu thập và cách thức sử dụng, qua đó giúp cá nhân có thêm quyền kiểm soát đối với thông tin cá nhân của mình. Trách nhiệm giải trình là yếu tố không thể thiếu của bất kỳ khuôn khổ pháp lý hoặc đạo đức nào. Khi AI ngày càng có mức độ tự chủ cao hơn, việc xác định rõ ai chịu trách nhiệm đối với các quyết định do hệ thống AI đưa ra càng trở nên quan trọng. Điều này đòi hỏi phải tích hợp các cơ chế bảo đảm sự giám sát của con người, đồng thời khiến quá trình ra quyết định của AI trở nên minh bạch và có thể giải thích được.

Song song với đó, vai trò của khung pháp lý là yếu tố then chốt đảm bảo AI được sử dụng hợp pháp và hợp lý, với sự điều tiết và quản lý của Nhà nước. Các chính phủ và các tổ chức quốc tế theo đó cần tính toán xây dựng và thực thi những quy định điều chỉnh việc ứng dụng AI trong lĩnh vực an ninh, xác lập ranh giới rõ ràng đối với thu thập dữ liệu cá nhân, hoạt động giám sát và các thuật toán ra quyết định. Những quy định này cần hướng tới thúc đẩy tính minh bạch và công bằng, đồng thời vẫn tạo điều kiện để AI phát huy hiệu quả trong ứng phó với các mối đe dọa mạng phức tạp.

Hiện nhiều quốc gia, tổ chức quốc tế đã có những chính sách nhằm đưa AI vào triển khai có khuôn khổ và có trách nhiệm. Ở quy mô toàn cầu, năm 2024, Đại hội đồng Liên Hợp Quốc (LHQ) đã thông qua nghị quyết đầu tiên liên quan tới lĩnh vực AI với các điều khoản thúc đẩy các hệ thống AI hoạt động "an toàn, bảo mật và đáng tin cậy" nhằm mang lại lợi ích là sự phát triển bền vững cho tất cả mọi người.

Trong văn kiện, Đại hội đồng đã nêu bật tầm quan trọng của việc tôn trọng, bảo vệ và thúc đẩy nhân quyền trong quá trình thiết kế, phát triển, triển khai và sử dụng AI, đồng thời kêu gọi tất cả các quốc gia thành viên và các bên liên quan "kiềm chế hoặc chấm dứt việc sử dụng các hệ thống AI không phù hợp với luật nhân quyền quốc tế hay gây ra những rủi ro quá mức đối với việc thực hành nhân quyền".

Tháng 6/2024, Liên minh châu Âu (EU) đã thông qua đạo Luật AI Act. Đây hiện là bộ luật đầu tiên và toàn diện nhất, có nhiều sáng kiến nhằm đối phó với nguy cơ từ AI. Điểm nhấn của Luật AI Act là việc nó dựa trên rủi ro của các mô hình AI để điều chỉnh luật pháp theo hướng tương ứng, cùng với đó là khung pháp lý thử nghiệm (sandbox) và cách tiếp cận 'mềm hóa' về đạo đức, độ tin cậy và tính trách nhiệm.

Tại Mỹ, chính quyền cựu Tổng thống Mỹ Joe Biden đã ban hành sắc lệnh hành pháp nhằm giảm thiểu những rủi ro mà công nghệ AI có thể gây ra, thiết lập các tiêu chuẩn mới về an toàn và bảo mật, bảo vệ quyền riêng tư của người dùng, thúc đẩy đổi mới và cạnh tranh trong lĩnh vực AI. Tháng 11/2025, Tổng thống Donald Trump ký sắc lệnh hành pháp nhằm thiết lập bộ tiêu chuẩn quản lý thống nhất ở cấp liên bang cho lĩnh vực AI.

Trung Quốc và Nhật Bản cũng là hai quốc gia có nhiều bước tiến trong việc phát triển AI có trách nhiệm. Năm 2019, Trung Quốc đã ban hành bốn nguyên tắc, tập trung vào người xây dựng mô hình, người sử dụng, quản trị AI và định hướng phát triển AI trong tương lai. Trung Quốc chọn cách vừa tự chủ phát triển AI, vừa đẩy mạnh quản trị trong nước, còn Nhật Bản hướng tới bộ quy tắc AI lấy con người làm trung tâm và vẫn đảm bảo tham gia được các diễn đàn quốc tế.

Nhìn từ những kinh nghiệm và cách tiếp cận khác nhau đó, có thể thấy không tồn tại một “khuôn mẫu” duy nhất cho mọi quốc gia trong quản trị AI, đặc biệt là trong lĩnh vực an ninh mạng, vốn thay đổi từng ngày, từng giờ.

Điều quan trọng là mỗi nước cần chủ động nghiên cứu thực tiễn, tham khảo có chọn lọc các mô hình, khung pháp lý và chuẩn mực quốc tế, từ đó xây dựng chính sách phù hợp với trình độ phát triển, hệ sinh thái công nghệ và bối cảnh xã hội của mình.

Quản trị AI không chỉ là bài toán kỹ thuật hay pháp lý, mà còn là lựa chọn mang tính chiến lược về cách đặt con người, quyền riêng tư và giá trị nhân văn ở vị trí trung tâm. Khi được định hướng và kiểm soát đúng đắn, AI sẽ thực sự phát huy vai trò như một công cụ giúp bảo đảm an ninh mạng, thúc đẩy đổi mới sáng tạo và phục vụ sự phát triển bền vững.

Thái Hà

Bình luận