|

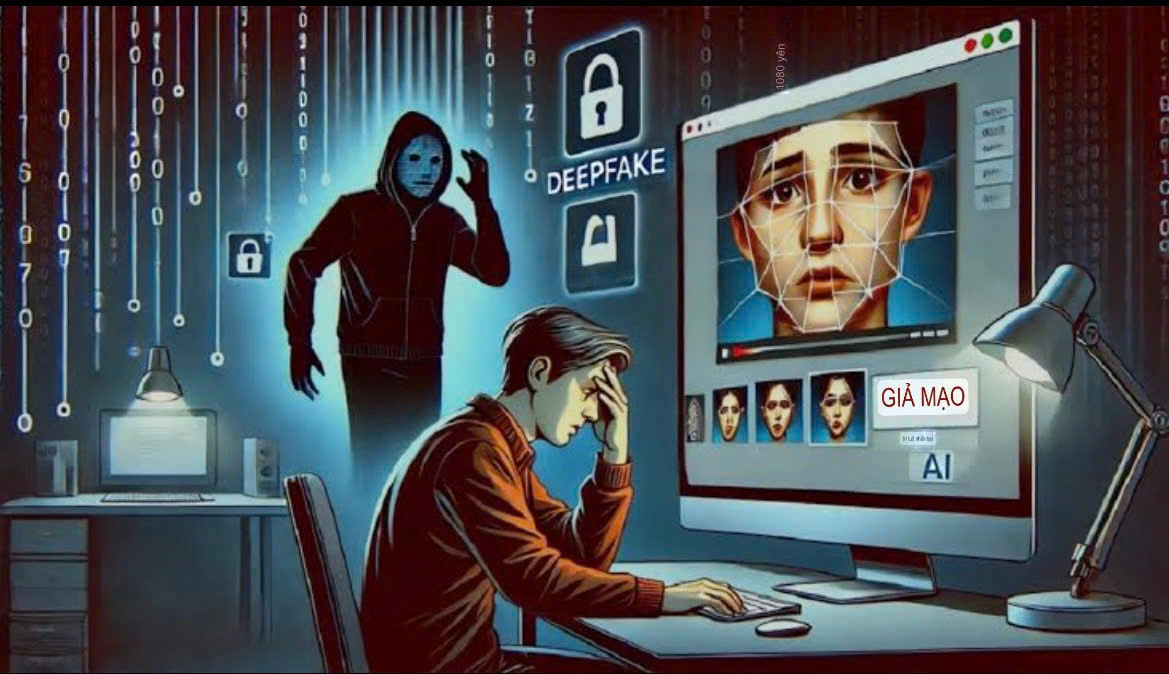

Theo cơ quan công an, Deepfake là công nghệ mô phỏng khuôn mặt con người bằng AI, có khả năng tạo ra hình ảnh, âm thanh hoặc video giả giống thật đến mức khó phân biệt. Từ công cụ phục vụ sáng tạo, Deepfake đang bị các đối tượng tội phạm mạng lợi dụng để giả mạo khuôn mặt, giọng nói và tài khoản mạng xã hội, nhằm lừa đảo, chiếm đoạt tài sản.

Thống kê của Hiệp hội Kế toán pháp lý toàn cầu cho thấy, các sự cố liên quan đến Deepfake trên toàn cầu đã tăng hơn 900% chỉ trong giai đoạn 2023-2025. Deloitte dự báo, gian lận do AI thúc đẩy có thể gây thiệt hại lên tới 40 tỉ USD cho ngành ngân hàng thế giới vào năm 2027.

Tại Việt Nam, năm 2024 ghi nhận hơn 220.000 báo cáo về lừa đảo trực tuyến, phần lớn liên quan đến tài chính - ngân hàng. Một admin của diễn đàn Chongluadao.vn cho biết, chỉ với vài thao tác, tội phạm có thể tạo video giả mạo khuôn mặt để thực hiện giao dịch chuyển tiền, trong khi nạn nhân không hề hay biết. Nhiều băng nhóm xuyên biên giới đã thu mua, thuê mở tài khoản ngân hàng, yêu cầu chủ tài khoản cung cấp video, thông tin cá nhân để phục vụ hack sinh trắc học, rồi chuyển lại dữ liệu cho đối tượng ở nước ngoài rửa tiền.

Cho tới thời điểm này, hệ thống sinh trắc học của các ngân hàng cơ bản vẫn an toàn, song công nghệ Deepfake đang khiến việc bảo mật trở nên thách thức hơn. “Ngân hàng và các tổ chức tín dụng cần thường xuyên cập nhật các diễn biến mới, rà soát lỗ hổng và tăng cường giải pháp phòng ngừa,” vị này khuyến cáo.

Theo các chuyên gia, nhiều ngân hàng trong giai đoạn đầu áp dụng xác thực khuôn mặt từng gặp lỗi vì hệ thống chưa tích hợp tính năng chống Deepfake. Khi các biện pháp xác thực định danh trực tuyến được kích hoạt đầy đủ - bao gồm phát hiện ảnh tĩnh, kiểm tra chuyển động tự nhiên - thì tình trạng gian lận đã giảm đáng kể. Tuy nhiên, các đối tượng lừa đảo vẫn tiếp tục “chạy đua công nghệ” để qua mặt hệ thống.

Ông Võ Đỗ Thắng, Giám đốc Trung tâm đào tạo an ninh mạng Athena, nhận định: “Một số giải pháp xác thực danh tính hiện nay có thể bị qua mặt bởi hình ảnh, video hoặc mặt nạ Deepfake. Nguyên nhân là do các hệ thống này chưa đạt chuẩn chất lượng hoặc chưa trải qua các bài kiểm tra hiệu suất trong nhiều điều kiện khác nhau. Đây là lỗ hổng bảo mật nghiêm trọng mà nhiều doanh nghiệp, không chỉ ở Việt Nam, đang phải đối mặt.” Ông nhấn mạnh, “Sinh trắc học là giải pháp bảo mật, nhưng bản thân nó cũng cần được bảo vệ bằng những cơ chế kiểm chứng nghiêm ngặt.”

Đồng quan điểm, ông Ngô Minh Hiếu, chuyên gia an ninh mạng, Giám đốc dự án Chongluadao.vn, cho rằng công nghệ giả mạo bằng AI đã đủ tinh vi để vượt qua các lớp bảo mật cơ bản như Face ID hay video call. “Vấn đề không nằm ở công nghệ sinh trắc học lạc hậu, mà ở việc nhiều ngân hàng chưa triển khai đủ lớp kiểm tra chống giả mạo như liveness detection hay deepfake detection,” ông nói. Ông đề xuất các ngân hàng cần nâng cấp hệ thống xác thực đa lớp, kết hợp AI chống Deepfake và tăng cường cảnh báo rủi ro cho người dùng.

Các chuyên gia đều thống nhất rằng, AI mang lại nhiều lợi ích nhưng cũng đang bị tội phạm công nghệ lợi dụng triệt để. Trong khi công nghệ phát triển từng ngày, an toàn số chỉ được đảm bảo khi ngân hàng, doanh nghiệp và người dùng cùng chủ động phòng ngừa và không ngừng cập nhật kỹ năng nhận diện lừa đảo.

An Lâm

Bình luận