|

| Các công cụ video AI khiến việc xác định đâu là video thật trở nên khó khăn hơn bao giờ hết. |

Người dùng mạng xã hội hiện nay dễ dàng tiếp cận các video hoặc hình ảnh được AI tạo ra, từ những nội dung vui nhộn như cảnh thỏ nhảy trampoline lan truyền khắp nơi, đến các sản phẩm giả lập ngày càng khó phân biệt thật - giả. Sora, ứng dụng nối tiếp ChatGPT của OpenAI, chính là công cụ đưa công nghệ video AI lên một cấp độ mới, thách thức người dùng nhận diện sự khác biệt.

Ra mắt năm 2024 và mới cập nhật bản Sora 2, ứng dụng này có giao diện hiện đại giống TikTok, cho phép tất cả nội dung đều được tạo tự động bằng AI. Không chỉ vậy, tính năng “cameo” còn giúp người dùng chèn ảnh nhân vật thật vào video giả lập, tạo ra những đoạn phim sống động, khó nhận biết bằng mắt thường.

Lo ngại trước nguy cơ deepfake tràn lan, nhiều chuyên gia cảnh báo Sora có thể thúc đẩy việc phát tán thông tin sai lệch và làm mờ ranh giới thật-giả. Những nhân vật nổi tiếng đặc biệt trở nên dễ bị tổn thương bởi video giả mạo, khiến các tổ chức như SAG-AFTRA lên tiếng đòi hỏi OpenAI tăng cường bảo vệ quyền hình ảnh.

Việc nhận diện các sản phẩm AI là thách thức không nhỏ, ngay cả với các nền tảng công nghệ lớn, mạng xã hội lẫn người dùng thông thường. Tuy nhiên, vẫn tồn tại một số phương pháp giúp người dùng tự kiểm tra tính xác thực của video do Sora tạo ra.

1Kiểm tra watermark Sora

|

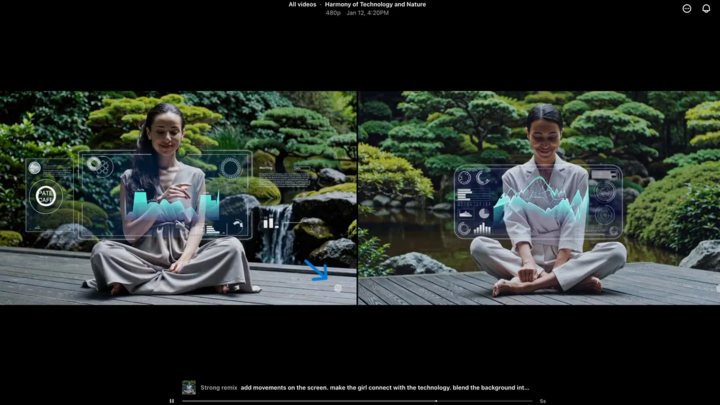

| Sora Watermark (mũi tên xanh chỉ vào) là dấu hiệu nhận biết video do công cụ nào tạo ra. |

Các video được xuất từ ứng dụng Sora trên iOS thường gắn watermark - biểu tượng đám mây màu trắng chuyển động quanh cạnh video, tương tự như watermark TikTok. Đây là dấu hiệu trực quan nhận diện nội dung AI. Tuy nhiên, watermark không phải lúc nào cũng đáng tin cậy vì có thể bị xóa hoặc cắt bỏ nếu ở dạng tĩnh và thậm chí watermark động cũng có nguy cơ bị xử lý bởi phần mềm chuyên dụng.

CEO OpenAI - Sam Altman - cho rằng xã hội cần thích ứng với việc bất cứ ai cũng có khả năng tạo ra video giả mạo thực tế. Sora là bước tiến mới, mang tới khả năng tiếp cận dễ dàng, phổ biến mà không yêu cầu kỹ năng phức tạp, do đó cần có giải pháp xác thực đa tầng.

Kiểm tra siêu dữ liệu video

|

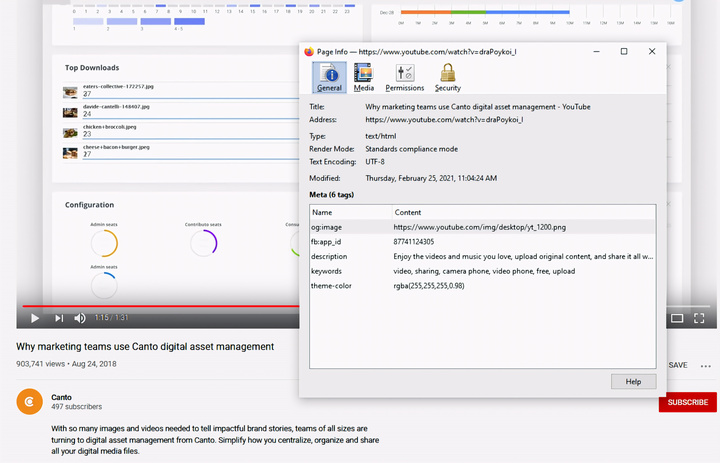

| Kiểm tra siêu dữ liệu - bước quan trọng giúp xác định video có phải do AI tạo ra, như Sora. |

Siêu dữ liệu là thông tin tự động gắn vào nội dung số khi được tạo ra, bao gồm loại thiết bị, địa điểm, thời gian quay, tên tệp. Đối với sản phẩm do AI tạo, siêu dữ liệu thường đính kèm thông tin xác thực nguồn phát sinh.

OpenAI hiện là thành viên sáng lập Liên minh chứng thực nội dung C2PA, do đó các video Sora đều có siêu dữ liệu C2PA. Người dùng có thể kiểm tra theo các bước sau:

-

Truy cập verify.contentauthenticity.org

-

Tải lên video cần kiểm tra

-

Nhấn “Mở” và xem chi tiết ở bảng thông tin bên phải

Nếu video phát sinh bởi AI, phần tóm tắt sẽ hiển thị rõ ràng nội dung đó, bao gồm dòng “do OpenAI phát hành” xác nhận sản phẩm từ Sora. Tất cả video Sora đều bắt buộc có siêu dữ liệu này để truy xuất nguồn gốc.

Trong môi trường số ngày càng nhiều nội dung giả lập, việc chủ động kiểm tra watermark và siêu dữ liệu sẽ giúp người dùng hạn chế bị đánh lừa bởi deepfake, đồng thời góp phần bảo vệ thông tin cá nhân và cộng đồng.

Đình Hiếu

Bình luận