|

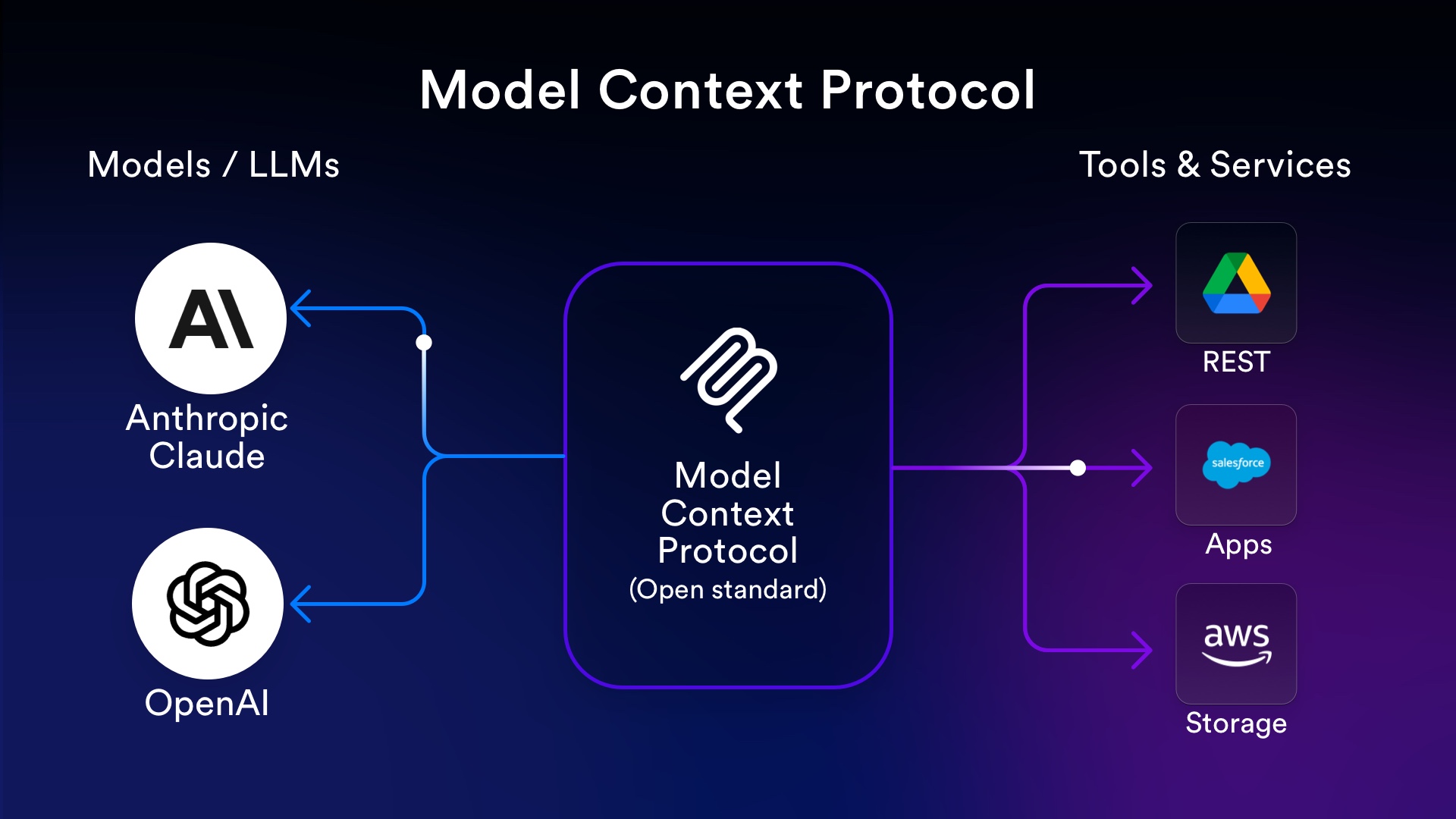

| Giao thức kết nối AI Model Context Protocol (MCP). Ảnh LightFlows |

Lỗ hổng và rủi ro từ giao thức AI

Ngày 24/9, Kaspersky cho biết đã tiến hành thử nghiệm và phát hiện rủi ro tiềm ẩn từ giao thức kết nối AI là Model Context Protocol (MCP). Đây là giao thức do Anthropic giới thiệu năm 2024, cho phép các hệ thống AI, đặc biệt là ứng dụng dựa trên mô hình ngôn ngữ lớn (LLM), kết nối và giao tiếp với nhiều dịch vụ bên ngoài. Nhờ đó, doanh nghiệp có thể sử dụng AI để tìm kiếm, chỉnh sửa tài liệu, quản lý mã nguồn, truy xuất cơ sở dữ liệu khách hàng hay xử lý thông tin tài chính và dữ liệu đám mây.

Quá trình thử nghiệm cho thấy MCP có thể trở thành “cửa ngõ” cho tin tặc. Trong thí nghiệm, nhóm chuyên gia đã dựng kịch bản một máy tính lập trình viên bị cài đặt máy chủ chạy theo chuẩn MCP, nhưng bị chỉnh sửa để phục vụ mục đích tấn công. Bằng cách này, tin tặc có thể dùng giao thức MCP đánh cắp dữ liệu nhạy cảm, cài mã độc hoặc kiểm soát hệ thống mà không cần đến các kỹ thuật xâm nhập.

Các nhà phân tích nhận định, điều đáng lo ngại là giao thức AI được thiết kế để mở rộng khả năng kết nối, đồng nghĩa với việc phạm vi rủi ro không chỉ nằm ở một hệ thống, mà có thể lan ra nhiều nền tảng tích hợp. Trong bối cảnh doanh nghiệp ngày càng phụ thuộc vào AI trong quản trị dữ liệu, những lỗ hổng dạng này có thể gây ra hậu quả nghiêm trọng.

Kaspersky cho biết, nếu một máy chủ chuẩn MCP bị chỉnh sửa, người dùng chỉ nhìn thấy phản hồi thông thường từ AI, nhưng hackers có thể thu thập dữ liệu nhạy cảm như mật khẩu, token API, hệ thống có thể bị cấu hình lại hoặc bị gắn cửa hậu (backdoor).

Từ đó, tin tặc có thể phát tán ransomware hoặc chiếm quyền điều khiển từ xa các thiết bị. Giao thức MCP là mã nguồn mở nên bất kỳ ai cũng có thể triển khai hoặc sửa đổi, làm tăng nguy cơ bị tấn công khi các tổ chức sử dụng máy chủ chuẩn MCP chưa kiểm định hoặc lấy từ diễn đàn trực tuyến.

Hiện chưa có báo cáo về vụ tấn công thực tế trên giao thức MCP, nhưng trong bối cảnh AI ngày càng được tích hợp sâu vào quy trình doanh nghiệp, việc sử dụng máy chủ không an toàn có thể dẫn đến xu hướng tấn công chuỗi cung ứng, các thành phần bên thứ ba của hệ thống. Mohamed Ghobashy, chuyên gia Kaspersky nhận định, tấn công chuỗi cung ứng hiện là một trong các mối đe dọa nghiêm trọng nhất trong an ninh mạng.

Ở Việt Nam, khoảng 18% doanh nghiệp đã bắt đầu ứng dụng AI, tương đương khoảng 170.000 đơn vị, với tốc độ tăng 39% so với năm trước. Dù phần lớn mới dừng ở ứng dụng cơ bản, số doanh nghiệp đưa AI vào lõi sản phẩm vẫn chiếm tỉ lệ nhỏ. Sự bùng nổ AI trong nhiều lĩnh vực khiến nhu cầu tích hợp giao thức như MCP trở nên hấp dẫn - đồng thời làm tăng rủi ro nếu không có biện pháp kiểm tra, bảo mật nghiêm ngặt.

Giảm thiểu nguy cơ từ giao thức AI: chú trọng bảo mật và giám sát

Để giảm thiểu nguy cơ từ giao thức AI như MCP, các chuyên gia đề xuất rằng doanh nghiệp và tổ chức cần đặt bảo mật làm ưu tiên với việc đánh giá nguồn gốc máy chủ trước khi triển khai. Mỗi khâu trong hệ thống, từ phát triển, kiểm thử đến vận hành, đều cần được xem xét như một mắt xích quan trọng trong bảo mật tổng thể, nhằm hạn chế lan truyền rủi ro khi áp dụng các giao thức AI.

Bên cạnh đó, việc giám sát bất thường trong dữ liệu và hành vi truy cập, áp dụng chính sách chế độ chạy ở môi trường giới hạn (sandboxing, containerization) và sử dụng công cụ phát hiện xâm nhập (IDS/IPS) đóng vai trò quan trọng để phát hiện sớm dấu hiệu nguy hại.

Cuối cùng, các doanh nghiệp, tố chức cần đánh giá thường xuyên (security audit) và cập nhật bản vá, phiên bản mới cho các thành phần liên quan đến kết nối AI, thiết lập quy trình “kiểm định - giám sát - phản ứng” chặt chẽ nhằm kiểm soát an ninh hệ thống hiệu quả và giảm thiểu tối đa nguy cơ bị tấn công.

An Lâm

Bình luận