Chỉ với vài chục giây lướt mạng xã hội, người dùng có thể bắt gặp những video bán hàng, kể chuyện đời thường đầy cảm xúc, nhân vật xuất hiện tự nhiên, bối cảnh chân thực, lời nói tròn trịa và biểu cảm “rất người”. Nhưng phía sau những thước hình tưởng như đời thực ấy, ngày càng nhiều nội dung được tạo ra hoàn toàn hoặc phần lớn bằng trí tuệ nhân tạo (AI).

AI đang bị kéo lệch khỏi giá trị cốt lõi

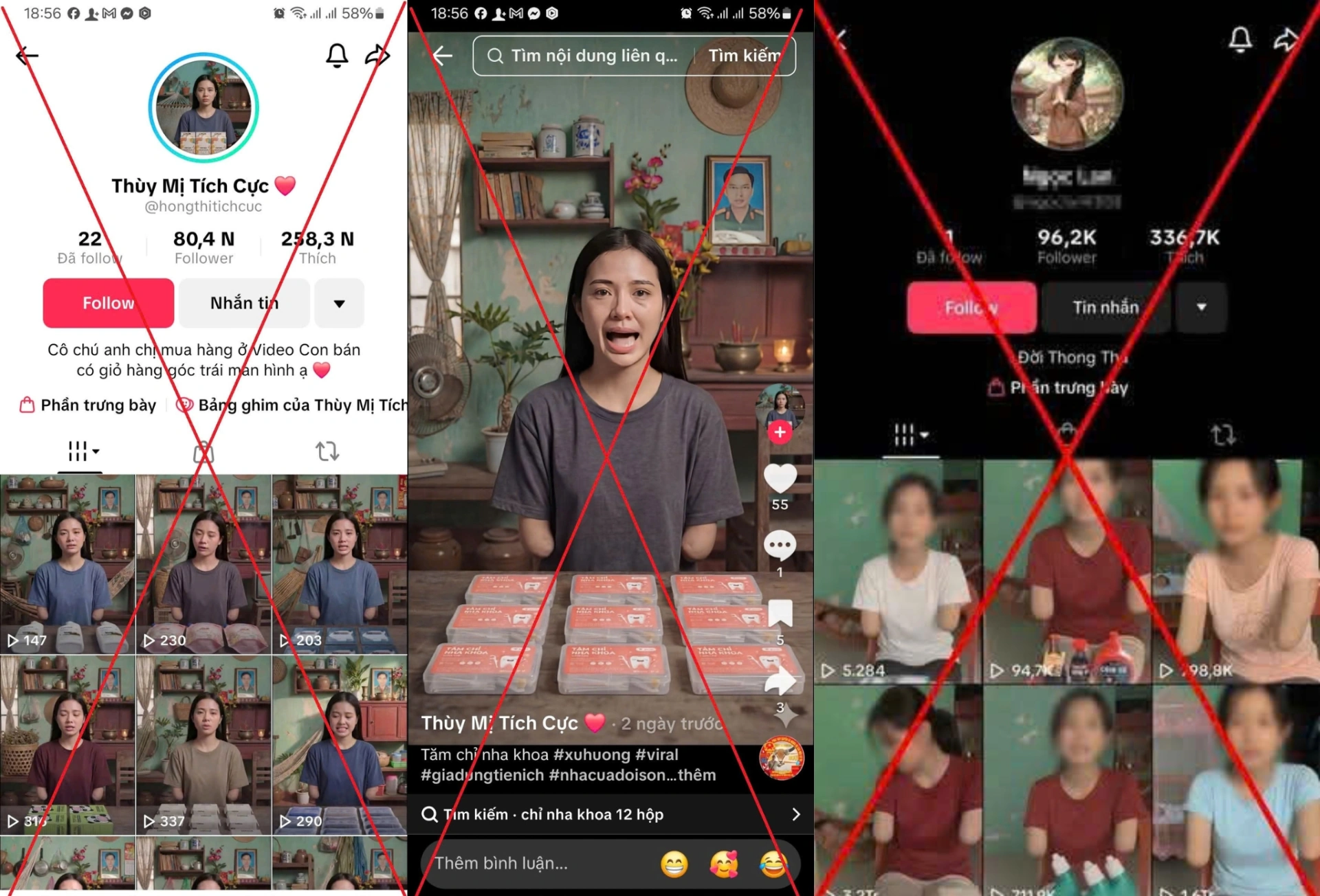

Trong thời gian gần đây, cộng đồng mạng xôn xao trước loạt tài khoản mạng xã hội sở hữu hàng chục nghìn đến hàng trăm nghìn lượt theo dõi, đăng tải video bán hàng hoặc chia sẻ câu chuyện đời sống với nhân vật trung tâm được xây dựng đầy cảm xúc. Từ hoàn cảnh khó khăn, khiếm khuyết cơ thể, đến hình ảnh lao động giản dị, hiền lành, các video này dễ dàng tạo được sự đồng cảm mạnh mẽ, kéo theo lượng tương tác lớn và hành vi mua hàng hoặc ủng hộ không nhỏ từ người xem.

|

|

Nếu người dùng phân tích kỹ qua hình ảnh, biểu cảm khuôn mặt, chuyển động môi và giọng nói, sẽ dễ nhận ra nội dung được sử dụng AI tạo sinh, deepfake hoặc ít nhất là can thiệp mạnh bằng công nghệ số. Nhân vật có thể không tồn tại ngoài đời thực, hoặc được “tái tạo” từ dữ liệu tổng hợp, nhưng lại được trình bày như người thật, sống thật, bán hàng thật.

Vấn đề cách AI đang bị khai thác để tạo dựng niềm tin sai lệch. Khi người xem tin rằng họ đang ủng hộ một con người thật với hoàn cảnh thật, trong khi thực tế đó chỉ là một sản phẩm công nghệ được thiết kế để tối ưu tương tác và doanh thu, niềm tin của xã hội bị bào mòn một cách âm thầm.

Đáng lo ngại hơn, nhiều tài khoản dạng này không hề công bố việc sử dụng AI, không gắn nhãn nội dung tổng hợp, thậm chí còn cố tình dẫn dắt người xem tin rằng nhân vật trong video là người thật. Điều này khiến AI từ một công cụ hỗ trợ sáng tạo trở thành phương tiện thao túng cảm xúc, đánh vào lòng trắc ẩn và sự cả tin của cộng đồng.

Đây cũng chính là vấn đề mà Luật Trí tuệ nhân tạo vừa được Quốc hội thông qua, Luật nhấn mạnh yêu cầu minh bạch trong quá trình sử dụng AI, đặc biệt với các nội dung tổng hợp, mô phỏng con người hoặc can thiệp sâu bằng công nghệ tạo sinh. Theo đó, tổ chức, cá nhân tạo nội dung có trách nhiệm gắn nhãn, thông báo rõ ràng để người dùng nhận biết đây là sản phẩm có sử dụng AI, tránh gây nhầm lẫn giữa nội dung thật và nội dung do công nghệ tạo ra.

Không khó để lý giải vì sao các nội dung kiểu này nở rộ. Thuật toán mạng xã hội ưu tiên video có thời lượng xem dài, tương tác cao và cảm xúc mạnh. AI, với khả năng tạo hình ảnh ổn định, biểu cảm nhất quán, giọng nói dễ nghe và kịch bản được tối ưu, trở thành công cụ lý tưởng để “sản xuất cảm xúc” hàng loạt.

Trong bối cảnh kinh tế khó khăn, niềm tin xã hội mong manh và thói quen mua sắm online ngày càng phổ biến, người dùng dễ bị cuốn theo những câu chuyện được kể khéo léo bằng công nghệ. Chỉ cần một gương mặt hiền lành, một không gian quen thuộc và vài câu nói chạm đúng cảm xúc, ranh giới cảnh giác của người xem nhanh chóng bị hạ thấp.

Nguy hiểm ở chỗ, khi các nội dung này bị phanh phui, hậu quả không chỉ dừng ở một vài người bị lừa tiền. Lớp tổn thất lớn hơn là sự hoài nghi lan rộng: người dùng bắt đầu nghi ngờ cả những câu chuyện thật, những hoàn cảnh cần được giúp đỡ thực sự. AI, thay vì được nhìn nhận như một tiến bộ công nghệ, lại bị gán mác công cụ lừa đảo, gây phản tác dụng đối với sự phát triển lành mạnh của xã hội số.

Các chuyên gia công nghệ cho rằng, Việt Nam đang trở thành “vùng trũng nhận thức” về AI. Công nghệ phát triển nhanh hơn khả năng phân biệt thật – giả của người dùng phổ thông. Trong khi đó, hành lang pháp lý và cơ chế giám sát nội dung AI trên nền tảng số vẫn chưa theo kịp thực tiễn, tạo ra khoảng trống cho các hành vi trục lợi.

Cảnh báo người dùng: đừng trao niềm tin chỉ vì cảm xúc

Trước thực trạng AI bị lạm dụng để đánh lừa cảm xúc, các chuyên gia an ninh mạng đưa ra khuyến nghị: người dùng cần thay đổi cách tiếp cận nội dung trên mạng xã hội.

Trước hết, cần tập thói quen nghi ngờ tích cực. Một video quá hoàn hảo, nhân vật nói năng trơn tru không vấp, biểu cảm nhất quán đến mức “vô cảm”, hoặc lặp lại cùng một bối cảnh qua nhiều video bán hàng, đều là những dấu hiệu cần đặt câu hỏi. Người xem không nên vội tin vào câu chuyện được kể, đặc biệt khi nội dung gắn trực tiếp với hành vi chuyển tiền, mua sản phẩm hoặc kêu gọi ủng hộ.

Thứ hai, cần kiểm tra chéo thông tin. Một nhân vật “có thật” thường để lại dấu vết xã hội: bạn bè, tương tác đời thực, hình ảnh đa dạng theo thời gian. Những tài khoản chỉ tồn tại trên một nền tảng, nội dung đồng nhất, thiếu tương tác tự nhiên, rất có thể chỉ là sản phẩm được dựng bằng AI.

Quan trọng hơn, người dùng cần nhận thức rằng cảm xúc mạnh không đồng nghĩa với sự thật. AI hiện nay đủ khả năng tạo ra những câu chuyện lay động lòng người, nhưng điều đó không khiến câu chuyện ấy trở nên chân thực. Việc bảo vệ niềm tin không chỉ là trách nhiệm cá nhân, mà còn là cách để không tiếp tay cho các mô hình kinh doanh dựa trên lừa dối.

Về phía nền tảng và cơ quan quản lý, việc sớm yêu cầu gắn nhãn nội dung AI, tăng cường phát hiện deepfake và xử lý nghiêm các hành vi trục lợi từ công nghệ là điều không thể chậm trễ. Nếu không, mạng xã hội sẽ tiếp tục trở thành môi trường thử nghiệm cho những hình thức thao túng tinh vi hơn, nơi người dùng luôn là bên yếu thế.

Khi công nghệ được đặt vào tay những người coi niềm tin là tài nguyên để khai thác, xã hội sẽ phải trả giá. Cảnh giác, tỉnh táo và hiểu đúng về AI chính là hàng rào phòng vệ đầu tiên của người dùng trong kỷ nguyên số đầy biến động.

Thu Uyên

Bình luận